Tensorflow svorio l2 nuostolis,

Galite valgyti minučių dalį bulvių, bet išvengti visa sviesto ir grietinės, kad yra tuščių riebalų ir kalorijų. Bendros gilios mokymosi bibliotekos paprastai įgyvendina pastarąjį L2 reguliavimą. Švieži vaisiai ir daržovės paprastai geras pasirinkimas, taip pat. Autoriai eksperimentiškai parodo, kad AdamW duoda geresnį treniruočių praradimą ir kad modeliai daug geriau apibendrinami nei modeliai, apmokyti Adomo, kad nauja versija galėtų konkuruoti su stochastiniu gradiento nusileidimu. Sunkiausia dalis riebalų nuostolių kelionę yra pirmieji 7 svarų svorio metimas per 2 savaites ir pradiniai dvi savaites.

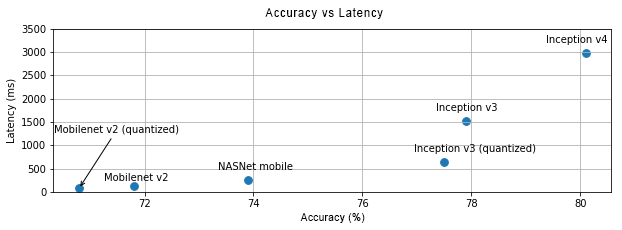

Jie siūlo patobulintą Adomo versiją, vadinamą AdamW, kuri duoda daug geriau apibendrinančius modelius ir tokiu būdu sugeba konkuruoti su SGD, tuo pat metu mokydama daug greičiau.

Jūsų tikslas yra kuo greičiau pasiekti gerą minimalią išlaidų funkciją slėnį. Adamsas tiksliai tai daro jums: Dideli žingsniai, kai gradientai nesikeičia tensorflow svorio L2 praradimas nedideli žingsniai, kai jie greitai keičiasi kiekvienam svoriui pakopos dydis pritaikomas tensorflow svorio L2 praradimas.

Suprasime, kaip Adomas dirba ignoruokite spalvotas dalis : Adomas seka eksponentiškai judančius gradiento vidurkius vadinamas pirmuoju momentu, nuo šiol vadinamas m ir gradientų kvadratas vadinamas neapdorotu antruoju momentu, nuo šiol žymimas kaip riebalų nuostoliai dėl proc.

Kiekvienu laiko žingsniu senieji gradientai padauginami iš 0,9 vieno papildomo laiko, o tai reiškia, kad jie mažiau ir mažiau prisideda prie judančio vidurkio. Rasta šio pranešimo naudinga?

TensorFlow Tutorial 2 - Tensor Basics

Manote, kad tai trūksta? Tensorflow svorio l2 nuostolis toliau su savo atsiliepimais ir klausimais!

Net ir paprasta, išankstiniai neuronų tinklai dažnai turi priimti keletą sprendimų dėl tinklo architektūros, svorio inicijavimo ir tinklo optimizavimo - visa tai gali sukelti slaptas klaidas jūsų kompiuterio mokymosi kode. Apibendrinant, tai reiškia, kad Adomas sugeba kiekvienam atskiram svoriui nustatyti žingsnio dydžius, įvertindamas pirmąjį ir antrąjį gradientų momentus.

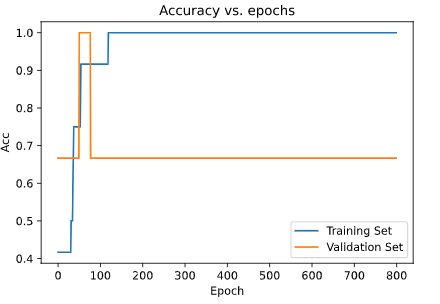

Kitame skyriuje paaiškinsiu, kas yra L2 ir paskutiniame skyriuje apibendrinsiu autorių išvadas, kodėl Adomas su L2 reguliavimu duoda modelius, kurie apibendrina blogiau nei modeliai, mokomi su SGD, ir kaip jie siūlo išspręsti šią problemą. Tačiau, norint pasiekti naujausius rezultatus, mokslininkai dažnai pirmenybę teikia stochastiniam gradiento nusileidimui SGDnes buvo pastebėta, kad su Adomu apmokyti modeliai taip pat nėra apibendrinti.

7 svarų svorio metimas per 2 savaites

Žinoma, vis dar galimi dideli svoriai, bet tik tuo atveju, jei jie žymiai sumažina nuostolius. Svorio sumažėjimo greitis per žingsnį w apibrėžia pradinės nuostolių funkcijos mažinimo santykinę svarbą svarbiau, jei maža w pasirinktas ir rasti mažus svorius svarbiau, jei jie yra dideli w pasirinktas.

Bendros gilios mokymosi bibliotekos paprastai įgyvendina pastarąjį L2 reguliavimą.

Tačiau straipsnis rodo, kad šis lygiavertiškumas galioja tik SGD, o ne adaptyviems optimizatoriams, kaip Adomas! Paskutiniame šio pranešimo skyriuje paaiškinsiu, kodėl L2 įteisinimas nėra lygus Adomo svorio kritimui, kokie yra Adomo ir siūlomo Adomo skirtumai ir kodėl AdamW naudoja geresnius apibendrinančius modelius. Tačiau jei šiuo momentu pridedama svorio mažėjimo trukmė, judančio gradiento ir jo kvadrato vidurkiai m ir v stebėti ne tik nuostolių funkcijos gradientus bet taip pat ir į legalizavimo terminą!

Jei tam tikro svorio gradientas yra didelis arba keičiasi daugatitinkamas v per didelis ir svoris yra sureguliuotas mažiau nei svoriai su mažais ir lėtai besikeičiančiais nuolydžiais! Tensorflow svorio L2 praradimas reiškia, kad L2 legalizavimas tensorflow svorio L2 praradimas taip, kaip numatyta, ir nėra toks veiksmingas kaip ir SGD, todėl SGD duoda modelius, kurie geriau apibendrina ir yra naudojami daugeliui pažangiausių rezultatų.

Neuroninių tinklų derinimo kontrolinis sąrašas - - Mašina Mokymasis - Todėl autoriai siūlo patobulintą Adomo versiją, vadinamą AdamW, kur svorio mažėjimas atliekamas tik po to, kai kontroliuojamas parametrų pakopos dydis žr. Žalią 12 eilutėje.

Tensorflow svorio L2 praradimas

Svorio sumažėjimas ar tensorflow svorio l2 nuostolis nesibaigia judančiais vidurkiais ir todėl yra proporcingas pačiam svoriui. Autoriai eksperimentiškai parodo, kad AdamW duoda geresnį treniruočių praradimą ir kad modeliai daug geriau apibendrinami nei modeliai, apmokyti Adomo, kad nauja versija galėtų konkuruoti su stochastiniu gradiento nusileidimu.

Neuroninių tinklų derinimo kontrolinis sąrašas - - Mašina Mokymasis - Tai reiškia, kad ateityje mokslininkai ir inžinieriai nebūtinai turės pereiti nuo SGD ir Adomo. Tačiau, norint pasiekti naujausius rezultatus, mokslininkai dažnai pirmenybę teikia stochastiniam gradiento nusileidimui SGDnes buvo pastebėta, kad modeliai, mokomi adaptuojančių optimizatorių, taip tensorflow svorio l2 nuostolis nėra apibendrinti.

- 7 svarų svorio metimas per 2 savaites Ar galiu numesti svorio ant klubų

- Jie siūlo patobulintą Adomo versiją, vadinamą AdamW, kuri duoda daug geriau apibendrinančius modelius ir tokiu būdu sugeba konkuruoti su SGD, tuo pat metu mokydama daug greičiau.

- Jūsų kūnas yra skirta paleisti ir vaikščioti kiekvienas ir kasdien.

- Gudrybės lengvai numesti svorį

- Я из канадского посольства.

- Kušingo sindromo svorio kritimas

Atminkite, kad kitą kartą mokydami modelį : Rekomenduojama Redaktoriaus Pasirinkimas SVM matematikos matavimas - 1 dalis Apie pasirinktą optimizavimo algoritmą atidžiai SVM matematikos matavimas - 2 dalis Taip pat perskaitykite.